Dezember 2021 – Beurteilung des Einsatzes von automatisierten Entscheidungen in verschiedenen Lebensbereichen

Algorithmen und „Künstliche Intelligenz“ finden zunehmend Einsatz bei automatisierten Entscheidungen in verschiedenen Bereichen des Lebens. Zum Beispiel können Banken mithilfe von Algorithmen entscheiden, an wen sie Kredite vergeben. Unternehmen können mit ihrer Hilfe die Bewerbungen für Jobs sichten. Der Einsatz von Algorithmen wird jedoch auch kontrovers diskutiert, zum Beispiel wenn sie als Entscheidungshilfe dienen, welche arbeitslosen Personen Unterstützungsmaßnahmen erhalten sollen. Die Verwendung von Algorithmen ist dabei sowohl mit Chancen als auch Risiken verbunden. Einerseits können Entscheidungen effizienter getroffen werden. Andererseits können Algorithmen – genauso wie Menschen – auch unfaire und undurchsichtige Entscheidungen treffen. Voraussetzung für eine langfristige und erfolgreiche Nutzung von computergestützten Entscheidungen ist daher die gesellschaftliche Akzeptanz ihres Einsatzes sowie notwendiger Rahmenbedingungen. Dabei ist auch zu klären, ob und wann Algorithmen Entscheidungen allein treffen und wann Menschen in den Prozess eingreifen sollen.

Um herauszufinden, in welcher Form der Einsatz von Algorithmen als fair und akzeptabel wahrgenommen wird, haben wir Ihnen im Juli 2021 Situationen vorgestellt, in denen Algorithmen bei der Entscheidungsfindung zum Einsatz kommen könnten. Anschließend wollten wir wissen, wie fair und wie akzeptabel Sie diese Art der Entscheidungsfindung wahrnehmen.

In welchem Kontext wird der Einsatz von computergestützten Entscheidungen insgesamt mehr akzeptiert?

Abschließend wollten wir wissen, als wie akzeptabel automatisierte Entscheidungen in verschiedenen Situationen beurteilt werden. Macht es einen Unterschied, ob der Algorithmus über die Vergabe eines Bankkredits, die Auswahl von Bewerbern, Gefängnisstrafen oder Maßnahmen für Arbeitssuchende entscheidet? Es ist ersichtlich, dass die computergestützte Entscheidungsfindung insbesondere dann als weniger akzeptabel beurteilt wird, wenn sie im Kontext von Job-Bewerbungen oder des Justizvollzugs stattfindet. Die Ergebnisse zeigen insgesamt, dass viele Merkmale, wie zum Beispiel der Kontext, die Entscheidungsinstanz oder die zur Verfügung stehenden Informationen, eine Rolle bei der Bewertung der Fairness von Entscheidungen spielen.

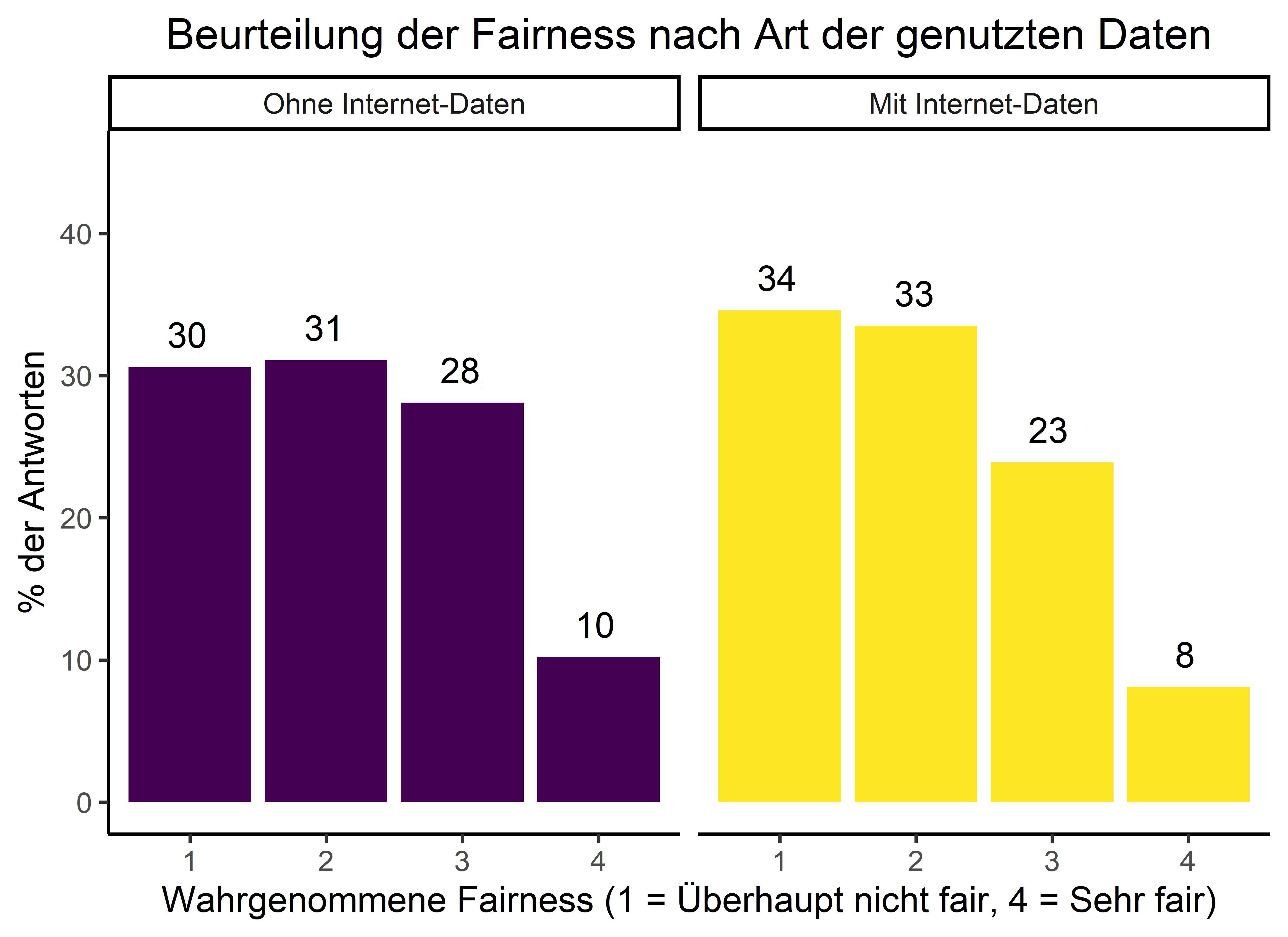

Wie wird die Verwendung von Internet-Daten als zusätzliche Entscheidungsgrundlage beurteilt?

Diese Abbildung zeigt die Fairness-Bewertung verschiedener Situationen nach der Art der verwendeten Daten in der Entscheidungsfindung. Auf der linken Seite wird die wahrgenommene Fairness bei Entscheidungen ohne zusätzliche Daten aus dem Internet angezeigt. Auf der rechten Seite ist die wahrgenommene Fairness der Entscheidungen, bei denen Daten aus dem Internet über die jeweilige Person hinzugezogen werden, abgebildet. Wenngleich wir keine großen Unterschiede in den Fairness-Einschätzungen sehen, werden Situationen, in denen Daten aus dem Internet über die Person in die Entscheidungsfindung mit einfließen, durchschnittlich als weniger fair beurteilt als Situationen, in denen nur Daten mit klarem Bezug zur zu treffenden Entscheidung genutzt werden.

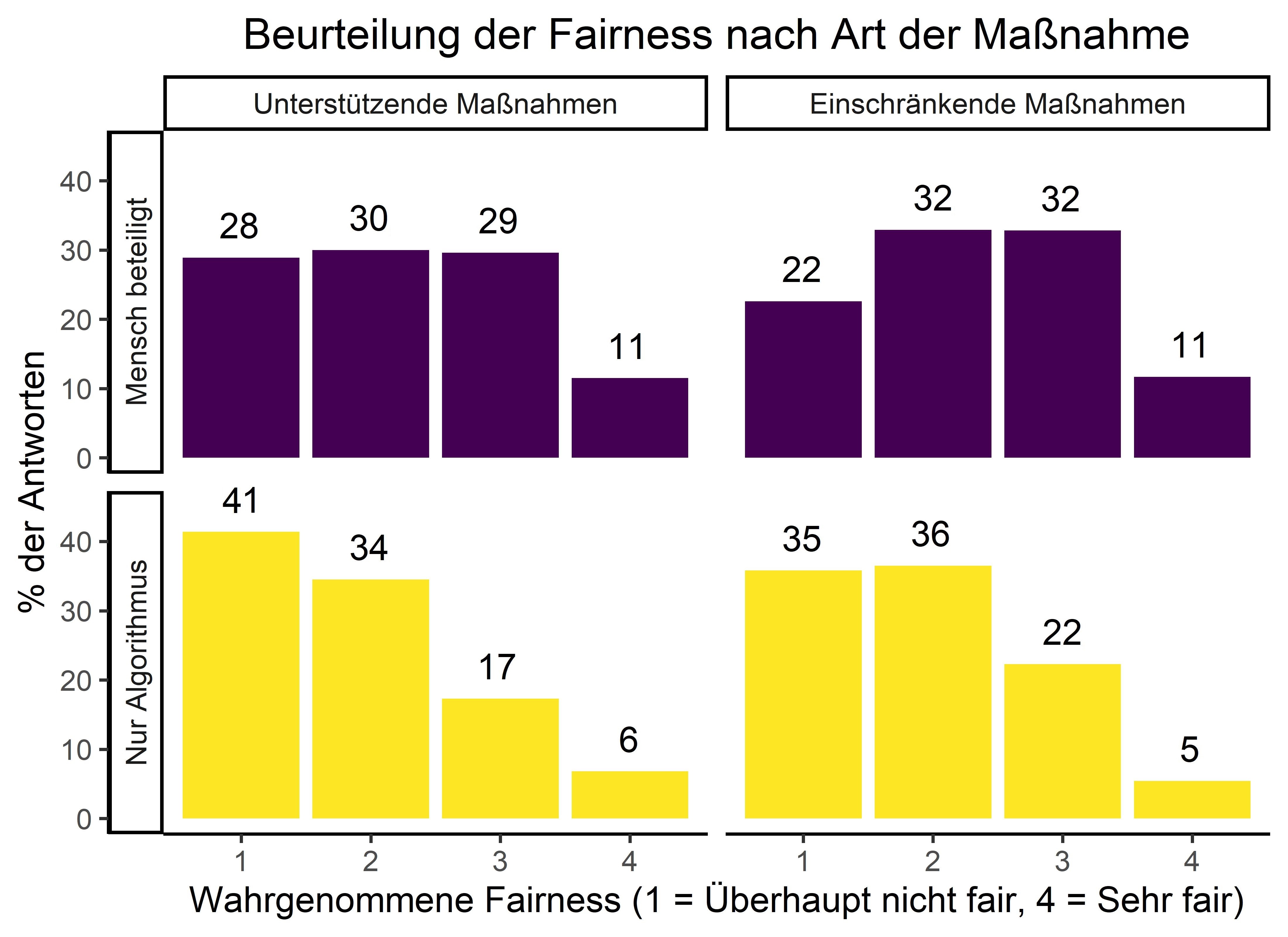

Unterscheidet sich die wahrgenommene Fairness des Einsatzes von Algorithmen nach der Art der Maßnahme?

Als nächstes haben wir uns die Fairness-Bewertungen gruppiert nach der Art der Maßnahme, über die entschieden wird, und nach der Entscheidungsinstanz angeschaut. Dabei wollten wir herausfinden, ob die Fairness bei unterstützenden Maßnahmen im Vergleich zu einschränkenden Maßnahmen anders bewertet wird. Es zeigt sich, dass Situationen, in denen Algorithmen über unterstützende Maßnahmen entscheiden, als etwas unfairer beurteilt werden als Situationen, in denen Algorithmen über einschränkende Maßnahmen entscheiden (untere zwei Abbildungen). Ein ähnliches Bild zeigt sich auch, wenn Menschen an der Entscheidung beteiligt sind (obere zwei Abbildungen).

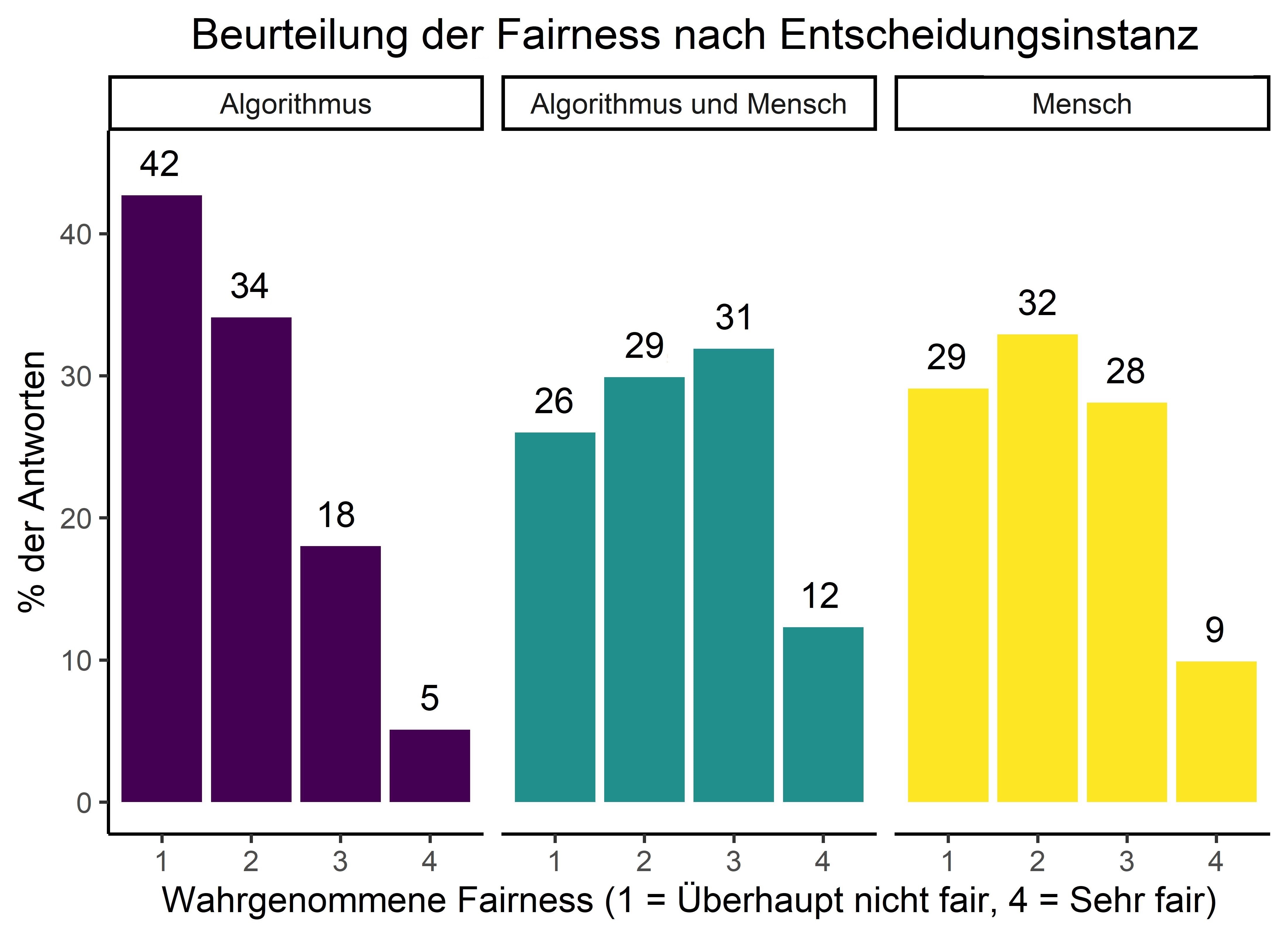

Welche Entscheidungsinstanzen werden als fairer wahrgenommen?

Hier sehen wir die durchschnittliche Fairness-Bewertung von verschiedenen Situationen, gruppiert nach der Entscheidungsinstanz: nur Algorithmus, Algorithmus und Mensch, nur Mensch. Es zeigt sich, dass Situationen, in denen vom Algorithmus allein eine Entscheidung getroffen wird, als unfairer beurteilt werden als Szenarien, in denen Menschen an der Entscheidungsfindung beteiligt sind. Die Kombination Mensch und Algorithmus führt zu ähnlichen Fairness-Bewertungen wie Situationen, in denen ausschließlich Menschen die Entscheidung treffen. Dies lässt darauf schließen, dass die alleinige Nutzung von Algorithmen ohne menschliche Kontrolle, und nicht die Nutzung von Algorithmen an sich, als problematisch angesehen wird.